Pierwotnie implanty ślimakowe miały pomagać osobom niesłyszącym w czytaniu mowy z ruchu warg. Dzięki wielkiemu postępowi w technologiach medycznych, otochirurgii i inżynierii rehabilitacyjnej ich użytkownicy nie tylko rozumieją mowę, lecz także mogą czerpać przyjemność ze słuchania złożonych dźwięków, jakimi są utwory muzyczne. Odbiór dźwięków przez implant, a precyzyjniej – subiektywna percepcja dźwięku użytkownika implantu ślimakowego, to fenomen, którego naukowcy jeszcze nie do końca zbadali. Trudno też im odpowiedzieć na najprostsze, jak może się wydawać, pytanie: jak pacjent słyszy dźwięki przez implant? O próbach symulacji dźwięków odbieranych przez implant oraz wynikach badań nad percepcją dźwięków osób zaimplantowanych mówił podczas Międzynarodowej Konferencji Naukowej „Muzyka w rozwoju słuchowym człowieka” prof. nadzw. dr hab. inż. Artur Lorens, kierownik Zakładu Implantów i Percepcji Słuchowej Instytutu Fizjologii i Patologii Słuchu.

Percepcja dźwięków użytkowników implantów ślimakowych to jeszcze mało poznane zagadnienie. Percepcja to proces odbioru i analizy informacji zmysłowej oraz jej interpretacji w świetle posiadanej wiedzy. Elementem percepcji dźwięku jest subiektywne wrażenie słuchowe, które trudne jest do poznania przez osobę postronną z uwagi na to, że trudno o nim precyzyjnie opowiedzieć. Naukowcy poszukują więc takich sposobów, dzięki którym można by usłyszeć to, co słyszy pacjent – użytkownik implantu ślimakowego. Przypomnijmy, implant ślimakowy to pierwsza na świecie stosowana w praktyce klinicznej proteza układu sensorycznego, dzięki której osobom nawet całkowicie niesłyszącym można przywrócić percepcję dźwięków. Proteza nie jest jednak tak doskonała jak ludzkie ucho – nie przekazuje wszystkich informacji o dźwiękach, czyli zniekształca odbierany dźwięk.

Jaka jest różnica pomiędzy protezą a uchem?

Dźwięk, jako fala akustyczna, wywołuje drgania błony bębenkowej, które – przechodząc przez ucho środkowe – trafiają do ucha wewnętrznego, ślimaka, gdzie pobudzane są komórki słuchowe (rzęsate), rozmieszczone wzdłuż błony podstawnej, w narządzie Cortiego. Zależnie od usytuowania komórki te reagują bardziej na tony o konkretnej częstotliwości, a słabiej na tony o innych częstotliwościach. Dzieje się tak, ponieważ drgania błony podstawnej wędrują od podstawy ślimaka w taki sposób, że miejsce maksymalnego wychylenia błony podstawnej zależy od częstotliwości sygnału akustycznego. Dla sygnałów o małej częstotliwości to miejsce wypada na szczycie ślimaka, natomiast w przypadku dźwięków o dużej częstotliwości bardziej wychylana jest jego część podstawna. Właściwość tę nazywamy tonotopią ślimaka. Dzięki tej właściwości tony wchodzące w skład dźwięku złożonego (w naszym przypadku muzyki) są jakby od siebie rozdzielane i informacja o nich w postaci impulsów nerwowych przekazywana jest osobno przez różne włókna nerwu słuchowego. To daje możliwość ich odróżnienia w ośrodkowym układzie nerwowym (w jego części zwanej drogą słuchową) i „wyprodukowania” adekwatnego wrażenia słuchowego. Wrażenie słuchowe powstaje bowiem w wyniku tzw. przetwarzania centralnego, czyli analizy informacji o dźwięku dokonywanej przez układ nerwowy, co stanowi podstawę percepcji dźwięku. Tak powstaje słuch wysokościowy pozwalający między innymi na rozróżnienie tonów o różnych częstotliwościach. Nazwa „wysokościowy” bierze się stąd, że subiektywne wrażenie wysokości dźwięku (dźwięk wysoki to taki bardziej piszczący, a dźwięk niski bardziej buczący) jest związane z częstotliwością drgań. Tony wysokie mają większą częstotliwość od tonów niskich. A zatem ucho działa w sposób podobny do analizatora częstotliwości, czyli urządzenia, które umożliwia rozkład złożonego dźwięku na składowe tonalne. Obrazowo mówiąc, podobnie jak światło białe rozdzielane jest na tęczę barw, tak z sygnału akustycznego dźwięki o wyższych częstotliwościach, które kodowane są bliżej podstawy ślimaka, zostają oddzielone od niższych, kodowanych bliżej szczytu ślimaka. Dlatego też, jak wspomniałem wcześniej, dwa tony niewiele różniące się częstotliwością słyszymy jako dwa różne dźwięki. Możliwość takiego rozróżnienia nazywana jest rozdzielczością częstotliwościową. U osób dobrze słyszących, mających ponad 3,5 tysiąca komórek słuchowych, rozdzielczość częstotliwościowa jest bardzo duża (jesteśmy w stanie usłyszeć różnicę poniżej 10 Hz), natomiast u osób z implantem ślimakowym – znacznie gorsza.

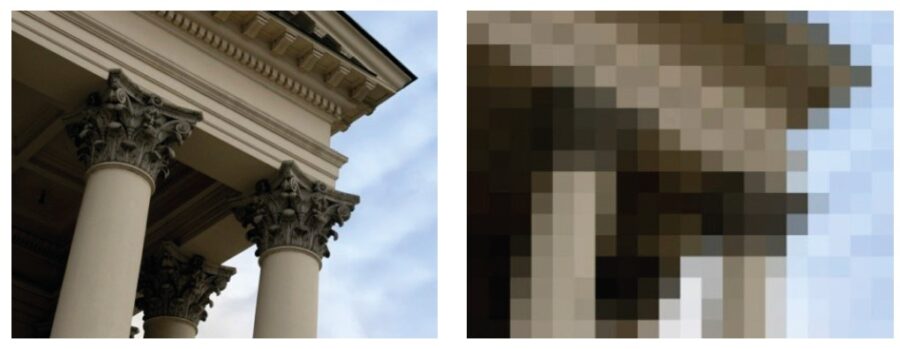

Słuch przez implant jest efektem stymulacji elektrycznej nerwu słuchowego za pośrednictwem wiązki elektrod wprowadzonych do ślimaka. Mamy zatem zaledwie kilka do kilkunastu separowalnych kanałów przekazu informacji drogą elektryczną. Taka stymulacja nie jest precyzyjna, ponieważ elektrody pobudzają duże fragmenty ślimaka wokół nich. Dwadzieścia czy dwanaście elektrod składających się na system implantu ślimakowego nie jest po prostu w stanie idealnie zastąpić tysięcy sprawnych komórek słuchowych. Co gorsza, zwiększenie liczby elektrod nie rozwiązuje problemu. Prąd stymulujący rozpływa się bowiem przestrzennie. Oznacza to, że uzyskanie tak specyficznego, ograniczonego do niewielkiego fragmentu nerwu słuchowego, pobudzenia dla danego tonu, jak ma to miejsce przy prawidłowym słuchu, jest niemożliwe na drodze stymulacji elektrycznej. Ma to poważne implikacje percepcyjne. Dźwięki, które pacjent może rozróżnić z uwagi na ich wysokość, będą różnić się nie o kilka lub kilkanaście herców, ale czasem nawet o kilkaset herców. Gdybyśmy odnieśli to do rozdzielczości obrazu, okazałoby się, że obraz odpowiadający słuchowi przez implant jest bardzo niewyraźny. Stąd też biorą się ograniczenia w słuchaniu m.in. muzyki, która jeszcze bardziej niż mowa wymaga śledzenia zmian wysokości dźwięku, co jest podstawą słyszenia określonej melodii. Wiemy natomiast od pacjentów, że przynajmniej część z nich świetnie ją słyszy, co dla naukowców jest wielką zagadką.

Nietrafione symulacje

Aby ją rozwiązać, naukowcy próbowali odtworzyć dźwięk słyszany przez różnych pacjentów przez implant, używając do tego tzw. modeli psychoakustycznych opartych o wokodery. Wokoder to nazwa pewnego sposobu przetwarzania dźwięku podobnego do tego, które ma miejsce w procesorze mowy systemu implantu ślimakowego, gdzie dźwięk zamieniany jest na bodziec elektryczny służący do stymulacji nerwu słuchowego. W efekcie takiej symulacji komputerowej słyszenia przez implant uzyskuje się dźwięk, który, zwłaszcza w przypadku muzyki, jest bardzo zniekształcony i nawet nie przypomina danego fragmentu muzycznego. Gdybyśmy, odpowiadając na często zadawane przez rodziny pacjentów pytanie, jak słychać dźwięk przez implant, zaprezentowali im takie symulacje, moglibyśmy ich tylko przestraszyć. Jakie słyszenie daje implant to zagadnienie interesujące zwłaszcza rodziców dzieci, które urodziły się niesłyszące i w przypadku których decyzja o implantacji musi zapaść jak najszybciej. Gdyby dowiedzieli się, że maluch będzie słyszał dźwięki podobne do tych uzyskanych podczas symulacji, ich reakcje mogłyby być bardzo emocjonalne. Nie dlatego jednak w kontaktach z pacjentami nie odwołujemy się do tych symulacji. Nie powołujemy się na nie, bo są one absolutnie sprzeczne z tym, czego przez ostatnie 30 lat naszej pracy dowiedzieliśmy się na temat specyfiki słuchu elektrycznego od użytkowników implantów pozostających pod naszą opieką.

O podobieństwie słuchu akustycznego i elektrycznego

Szansą na lepsze rozpoznanie problemu, jakim jest percepcja dźwięków przez implant, było rozszerzenie wskazań do implantacji przez prof. Henryka Skarżyńskiego. Po programie leczenia częściowej głuchoty, dla której charakterystyczny jest niedosłuch w zakresie wysokich częstotliwości przy zachowaniu prawidłowego słuchu dla częstotliwości niskich, prof. Skarżyński rozpoczął kolejny program wszczepiania implantów pacjentom z jednostronną głuchotą (słyszenie w jednym uchu jest całkowicie prawidłowe podczas gdy drugie jest całkowicie głuche albo ma bardzo głęboki niedosłuch). W ich przypadku wszczepienie implantu poprawia odbiór mowy w trudnych warunkach akustycznych. W badaniach laboratoryjnych przeprowadzanych po operacji można wykazać, że w zależności od warunków przestrzennego rozmieszczenia źródła mowy i źródeł sygnałów zakłócających rozumienie mowy w tej grupie pacjentów zwiększa się o 30, a nawet 40 procent po włączeniu systemu implantu, co diametralnie zmienia możliwości komunikacyjne. Wracając jednak do głównego tematu – wraz z uruchomieniem programu leczenia jednostronnej głuchoty rozpoczęliśmy nowe badania na temat percepcji przez implant z udziałem zakwalifikowanych do niego pacjentów. Podczas tych badań prowadzonych w IFPS od 2014 r. podaje się ten sam sygnał bezpośrednio do systemu implantu oraz do ucha zdrowego, prosząc pacjenta o opinię, na ile słuch elektryczny różni się od naturalnego. Dla dokładniejszego określenia tej różnicy stosujemy skalę od 0 do 10 punktów, gdzie 0 oznacza maksymalną rozbieżność pomiędzy słyszeniem elektrycznym i akustycznym, a 10 – całkowite podobieństwo. Wyniki tych badań są optymistyczne. Pacjenci wskazywali bowiem duże podobieństwo słyszenia elektrycznego i akustycznego (większe od 5 punktów na naszej skali). Jeden pacjent raportował nawet całkowite podobieństwo.

Kolejne badania zostały wykonane w ramach współpracy międzynarodowej pod kierunkiem prof. Michaela Dormana z Arizona State Uniwersity, z którym Instytut Fizjologii i Patologii Słuchu współpracuje od momentu, kiedy prof. Henryk Skarżyński uruchomił w 2002 roku program leczenia częściowej głuchoty (nazwisko prof. Dormana figuruje na tablicy „Przyjaciele po Wsze Czasy”). W tym roku ukazała się publikacja, w której zostały podsumowane wyniki nowych badań pacjentów włączonych do programu leczenia jednostronnej głuchoty [1]. W ramach tych badań podawano im wprost do zaimplantowanego ucha nagrane wcześniej zdanie, natomiast do ucha zdrowego – to samo zdanie, jednak ten dźwięk był komputerowo przetworzony w taki sposób, aby imitował on wrażenia odbierane przez implant. Następnie – kierując się wskazówkami pacjentów – modyfikowaliśmy dźwięk w taki sposób, aby jak najbardziej odpowiadał on temu, co pacjent słyszy przez protezę słuchu. W tych nowych badaniach kluczowe znaczenie mają rozmowy z zaimplantowanymi pacjentami i sposób opisywania subiektywnych wrażeń związanych z odbiorem dźwięku. Te rozmowy nie są łatwe – na pytanie, jak słyszymy, można bowiem odpowiadać, używając najrozmaitszych określeń. Można na przykład powiedzieć, że słyszymy w sposób zamazany, czysto, przejrzyście albo w sposób chropowaty. Aby więc lepiej zrozumieć, co dokładnie mają oni na myśli, z pomocą lingwistów próbujemy stworzyć polski słownik takich określeń. Ta praca zaczyna już przynosić efekty. Sugerując się podpowiedziami pacjentów, udało się tak przetworzyć dźwięki, że po podaniu ich do zdrowego ucha pacjenci raportowali prawie całkowite podobieństwo do tzw. oryginalnego dźwięku (nieprzetworzonego), ale podawanego bezpośrednio do procesora mowy i w ten sposób słyszanego tylko przez implant. Odpowiedniki dźwięku słyszanego przez implant, które do tej pory udało się uzyskać w toku prowadzonych eksperymentów, brzmią znacznie lepiej i są o wiele bardziej zrozumiałe niż wcześniejsze komputerowe symulacje oparte o psychoakustyczne modele wokoderowe [2].

Fenomen skrzypka z implantem

Zaskakujący dla nas jest przypadek pacjenta, według którego słyszenie przez implant nie różni się od słyszenia przez zdrowe ucho. Byliśmy ogromnie zdziwieni, kiedy podczas sesji badawczej z jego udziałem okazało się, że odtworzenie dźwięku słyszanego przez implant prawie nie wymagało komputerowej obróbki. Ten pacjent jest zawodowym muzykiem. Niedawno podzielił się z nami informacją, że to właśnie ucha implantowanego używa na scenie do strojenia skrzypiec. Jak wyjaśnić fakt, że słyszy on tak dobrze, iż wychwytuje najmniejsze niuanse w brzmieniu instrumentu, choć proteza dostarcza w porównaniu z uchem mocno ograniczoną informację o dźwięku? Odwołując się do tego przypadku, a także obserwacji rozwoju słuchowego innych osób muzykujących, możemy obecnie powiedzieć jedynie to, że jeśli wykształcenie muzyczne poprawia percepcję dźwięku przez implant, to znaczy, że mózg można wytrenować w taki sposób, aby w procesie odpowiednio zmodyfikowanego przetwarzania centralnego zrobił użytek nawet ze zdegradowanej i zniekształconej przez system implantu informacji o dźwięku. Naukowcy pracują nad dokładniejszym rozwiązaniem tej zagadki, koncentrując się na badaniach nad przetwarzaniem informacji o dźwiękach przez mózg, wykorzystując owoce olbrzymiego postępu w neuronauce czy kognitywistyce, który dokonał się w ostatnim czasie.

Opracowanie: JOLANTA CHYŁKIEWICZ

- Dorman M., Lorens A., Skarżyński H. i inni, Approximations to the Voice of a CochlearImplant: explorations with single-sideddeaf listeners. Trends in hearing 2020. https://www.ncbi.nlm.nih.gov/pmc/articles/pmc7225791/pdf/10.1177_2331216520920079.pdf

- https://www.dropbox.com/s/75ksbyqf9eb8g31/approximations_supplemental_3.wav?dl=0